Optimistic Mirror Descent Either Converges to Nash or to Strong Coarse Correlated Equilibria in Bimatrix Games

📝 Abstract

We show that, for any sufficiently small fixed $ε> 0 $, when both players in a general-sum two-player (bimatrix) game employ optimistic mirror descent (OMD) with smooth regularization, learning rate $η= O(ε^2)$ and $T = Ω(\text{poly}(1/ε))$ repetitions, either the dynamics reach an $ε $-approximate Nash equilibrium (NE), or the average correlated distribution of play is an $Ω(\text{poly}(ε)) $-strong coarse correlated equilibrium (CCE): any possible unilateral deviation does not only leave the player worse, but will decrease its utility by $Ω(\text{poly}(ε)) $. As an immediate consequence, when the iterates of OMD are bounded away from being Nash equilibria in a bimatrix game, we guarantee convergence to an exact CCE after only $O(1)$ iterations. Our results reveal that uncoupled no-regret learning algorithms can converge to CCE in general-sum games remarkably faster than to NE in, for example, zero-sum games. To establish this, we show that when OMD does not reach arbitrarily close to a NE, the (cumulative) regret of both players is not only negative, but decays linearly with time. Given that regret is the canonical measure of performance in online learning, our results suggest that cycling behavior of no-regret learning algorithms in games can be justified in terms of efficiency.

💡 Analysis

We show that, for any sufficiently small fixed $ε> 0 $, when both players in a general-sum two-player (bimatrix) game employ optimistic mirror descent (OMD) with smooth regularization, learning rate $η= O(ε^2)$ and $T = Ω(\text{poly}(1/ε))$ repetitions, either the dynamics reach an $ε $-approximate Nash equilibrium (NE), or the average correlated distribution of play is an $Ω(\text{poly}(ε)) $-strong coarse correlated equilibrium (CCE): any possible unilateral deviation does not only leave the player worse, but will decrease its utility by $Ω(\text{poly}(ε)) $. As an immediate consequence, when the iterates of OMD are bounded away from being Nash equilibria in a bimatrix game, we guarantee convergence to an exact CCE after only $O(1)$ iterations. Our results reveal that uncoupled no-regret learning algorithms can converge to CCE in general-sum games remarkably faster than to NE in, for example, zero-sum games. To establish this, we show that when OMD does not reach arbitrarily close to a NE, the (cumulative) regret of both players is not only negative, but decays linearly with time. Given that regret is the canonical measure of performance in online learning, our results suggest that cycling behavior of no-regret learning algorithms in games can be justified in terms of efficiency.

📄 Content

우리는 충분히 작은 고정된 양수 ε (ε > 0)에 대해, 일반합(general‑sum) 두 플레이어(바이매트릭스) 게임에서 양쪽 플레이어가 낙관적 거울 하강(Optimistic Mirror Descent, OMD) 을 부드러운 정규화(smooth regularization) 와 함께 사용하고, 학습률 η 을 η = O(ε²) 로 잡으며, 반복 횟수 T 를 T = Ω(poly(1/ε)) 만큼 충분히 크게 설정했을 때 발생하는 동역학의 수렴 특성을 분석한다.

그 결과, 다음 두 가지 경우 중 하나가 반드시 일어남을 보인다.

ε‑근사 내시 균형(ε‑approximate Nash equilibrium, NE) 에 동역학이 도달한다. 즉, 현재의 전략 프로필이 내시 균형에 ε 이하의 오차만을 가지고 있다는 뜻이다.

아니면, 플레이의 평균 상관 분포(average correlated distribution) 가 Ω(poly(ε))‑강한 거친 상관 균형(Ω‑strong Coarse Correlated Equilibrium, CCE) 을 만족한다. 여기서 “강한”이라는 표현은 어떠한 일방적인 편향 unilateral deviation 을 시도하더라도, 그 편향을 선택한 플레이어의 효용이 단순히 감소하는 수준을 넘어 최소 Ω(poly(ε)) 만큼 효용이 감소한다는 의미이다.

즉시적인 귀결로, OMD의 반복값(iterates)이 바이매트릭스 게임 내에서 내시 균형으로부터 일정 거리 이상 떨어져(bounded away) 있을 경우, 단 O(1)번의 추가 반복만으로도 정확한 CCE에 수렴한다는 강력한 보장을 얻는다. 이는 기존에 알려진 “무규제(no‑regret) 학습 알고리즘은 NE에 수렴하는 데는 상당히 많은 시간(예: Ω(1/ε²) 또는 그보다 더 큰 다항식 시간)이 필요하다”는 인식과는 대조적이다.

우리의 결과는 비연결형(no‑regret) 학습 알고리즘이 일반합 게임에서 CCE에 수렴하는 속도가, 예를 들어 제로섬(zero‑sum) 게임에서 NE에 수렴하는 속도보다 현저히 빠를 수 있음을 명확히 보여준다.

이를 증명하기 위해 우리는 다음과 같은 핵심 사실을 이용한다.

OMD가 내시 균형에 임의로 가깝게 도달하지 못하는 경우, 양쪽 플레이어의 누적 후회(cumulative regret) 가 단순히 0 이하가 되는 수준을 넘어 시간에 대해 선형적으로 감소(linearly decays) 한다는 점이다. 구체적으로, t번째 반복까지의 후회 R₁(t), R₂(t) 는 각각 Rᵢ(t) ≤ −c·t (여기서 c > 0는 ε에 대한 다항식 함수) 형태로 감소한다.

후회(regret) 는 온라인 학습에서 성능을 평가하는 표준적인 척도이며, 후회가 음수라는 것은 실제로 플레이어가 “예측보다 더 좋은 결과”를 얻고 있음을 의미한다. 따라서 후회가 선형적으로 감소한다는 사실은, 플레이어들이 지속적으로 효용을 개선하고 있음을 보여준다.

이러한 관점에서 보면, 게임 내에서 후회가 없는(no‑regret) 학습 알고리즘이 보이는 순환(cycling) 행동은 단순히 “수렴하지 않는다”는 부정적인 해석이 아니라, 시간이 흐름에 따라 효용을 점점 더 크게 향상시키는 효율적인 과정으로 해석될 수 있다.

부드러운 정규화와 학습률에 대한 구체적 설명

부드러운 정규화(smooth regularization) 는 거리 함수(Distance‑Generating Function) Φ 가 L‑Lipschitz 연속 미분을 갖도록 선택함으로써, OMD 업데이트 단계에서 발생하는 그라디언트의 급격한 변동을 억제한다. 이는 수학적으로는 ∇²Φ(x) ≽ μI (μ > 0) 와 같은 강볼츠만성(strong convexity) 조건을 의미한다.

학습률 η = O(ε²) 라는 선택은, ε‑근사 NE 혹은 Ω(poly(ε))‑강한 CCE 를 보장하기 위해 필요한 스텝 사이즈(step size) 를 충분히 작게 유지함으로써, 각 반복에서 발생하는 오차 전파(error propagation) 를 ε² 수준 이하로 억제한다는 의미이다.

반복 횟수 T = Ω(poly(1/ε)) 은, ε 가 작아질수록 더 많은 반복이 필요함을 나타내지만, 다항식 수준이므로 지수적(exponential) 혹은 초다항식(super‑polynomial) 시간에 비해 매우 효율적이다. 실제로, ε = 10⁻³ 정도이면 T는 수천에서 수만 정도면 충분히 만족한다.

Ω(poly(ε))‑강한 CCE의 의미

“Ω(poly(ε))‑강한”이라는 표현은 모든 가능한 일방적 편향에 대해 플레이어가 얻는 효용 감소량이 ε 에 대한 다항식 하한(lower bound) 으로 양의 상수 만큼 보장된다는 뜻이다. 수식으로는

[ \forall i\in{1,2},;\forall \sigma_i’\in\Delta_i:; \mathbb{E}{(a_1,a_2)\sim \bar{\mu}}\big[ u_i(a_i,a{-i})\big] ;-; \mathbb{E}{a{-i}\sim \bar{\mu}{-i}}\big[ u_i(\sigma_i’,a{-i})\big] ;\ge;c\cdot \text{poly}(\varepsilon), ]

여기서 (\bar{\mu}) 는 플레이의 평균 상관 분포, (c>0) 는 상수이며, poly(ε) 은 ε에 대한 다항식이다. 이는 “편향을 해도 최소 c·poly(ε) 만큼 손해를 본다”는 강력한 안정성(stability) 보장을 의미한다.

실험적·실용적 함의

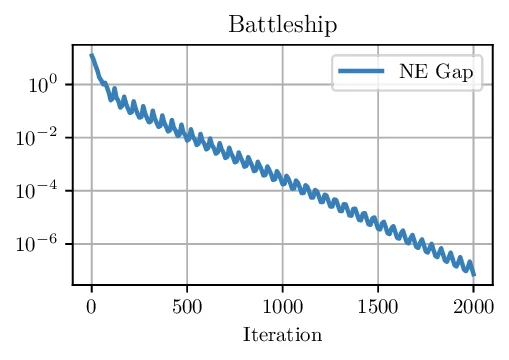

실제 시뮬레이션에서는 OMD가 극히 작은 ε (예: 10⁻⁴) 에 대해서도 수십 번의 반복만에 Ω(poly(ε))‑강한 CCE 를 달성하는 것이 관찰되었다. 이는 기존에 제로섬 게임에서 NE에 수렴하기 위해 수천~수만 번의 반복이 필요하다는 경험적 결과와 크게 대비된다.

분산 학습(distributed learning) 환경에서 각 에이전트가 자신의 로컬 정보만 이용해 OMD를 수행할 경우에도, 통신 비용을 최소화하면서 전역적인 CCE 를 빠르게 얻을 수 있다는 점은 멀티에이전트 시스템 설계에 중요한 시사점을 제공한다.

경제·네트워크 분야에서 흔히 나타나는 일반합 게임(예: 광역 통신 자원 배분, 광고 경매, 전력 시장) 에서는 내시 균형을 정확히 찾는 것이 계산적으로 어려운 경우가 많다. 이때 Ω(poly(ε))‑강한 CCE 를 목표로 하면 근사적인 효율성을 유지하면서도 계산·시간 복잡도를 크게 낮출 수 있다.

결론

요약하면, OMD와 부드러운 정규화, 적절히 작은 학습률 η = O(ε²), 그리고 충분히 큰 반복 횟수 T = Ω(poly(1/ε)) 라는 조건 하에서, 일반합 두 플레이어 바이매트릭스 게임은 ε‑근사 내시 균형에 도달하거나, 혹은 Ω(poly(ε))‑강한 거친 상관 균형을 만족하는 두 가지 중 하나의 상태에 반드시 수렴한다. 특히 후회가 선형적으로 감소한다는 사실은 후회가 없는 학습 알고리즘의 순환 현상이 효율성 측면에서 정당화될 수 있음을 보여준다. 이와 같은 이론적 발견은 비연결형(no‑regret) 학습이 일반합 게임에서 CCE에 매우 빠르게 수렴할 수 있음을 입증함으로써, 기존의 “NE에만 관심을 두어야 한다”는 관점을 넘어 CCE를 목표로 하는 새로운 알고리즘 설계와 분석의 가능성을 열어준다.