A Model of Job Parallelism for Latency Reduction in Large-Scale Systems

📝 Abstract

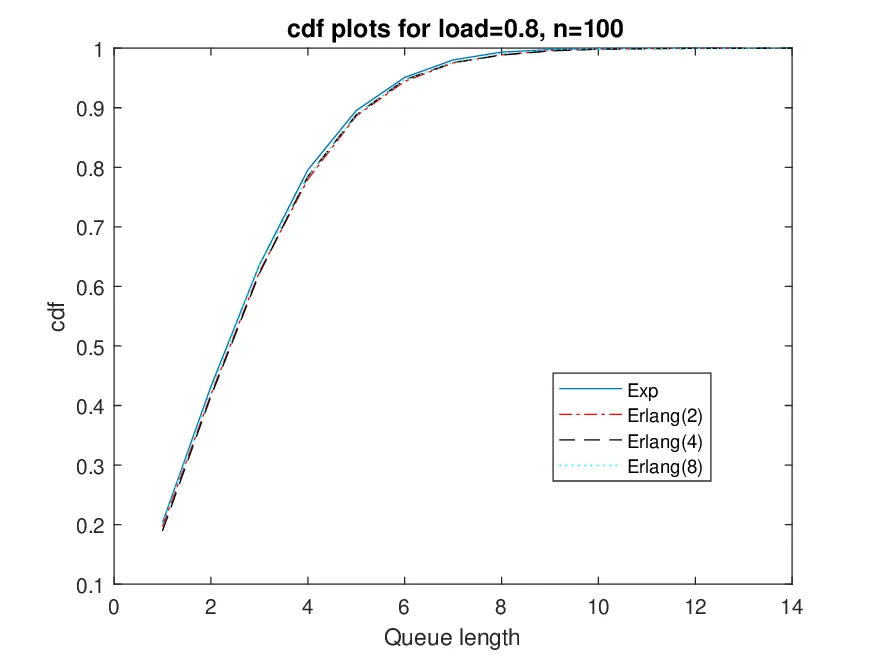

Processing computation-intensive jobs at multiple processing cores in parallel is essential in many real-world applications. In this paper, we consider an idealised model for job parallelism in which a job can be served simultaneously by $d$ distinct servers. The job is considered complete when the total amount of work done on it by the $d$ servers equals its size. We study the effect of parallelism on the average delay of jobs. Specifically, we analyze a system consisting of $n$ parallel processor sharing servers in which jobs arrive according to a Poisson process of rate $n λ$ ( $λ<1 $) and each job brings an exponentially distributed amount of work with unit mean. Upon arrival, a job selects $d$ servers uniformly at random and joins all the chosen servers simultaneously. We show by a mean-field analysis that, for fixed $d \geq 2$ and large $n $, the average occupancy of servers is $O(\log (1/(1-λ)))$ as $λ\to 1$ in comparison to $O(1/(1-λ))$ average occupancy for $d=1 $. Thus, we obtain an exponential reduction in the response time of jobs through parallelism. We make significant progress towards rigorously justifying the mean-field analysis.

💡 Analysis

Processing computation-intensive jobs at multiple processing cores in parallel is essential in many real-world applications. In this paper, we consider an idealised model for job parallelism in which a job can be served simultaneously by $d$ distinct servers. The job is considered complete when the total amount of work done on it by the $d$ servers equals its size. We study the effect of parallelism on the average delay of jobs. Specifically, we analyze a system consisting of $n$ parallel processor sharing servers in which jobs arrive according to a Poisson process of rate $n λ$ ( $λ<1 $) and each job brings an exponentially distributed amount of work with unit mean. Upon arrival, a job selects $d$ servers uniformly at random and joins all the chosen servers simultaneously. We show by a mean-field analysis that, for fixed $d \geq 2$ and large $n $, the average occupancy of servers is $O(\log (1/(1-λ)))$ as $λ\to 1$ in comparison to $O(1/(1-λ))$ average occupancy for $d=1 $. Thus, we obtain an exponential reduction in the response time of jobs through parallelism. We make significant progress towards rigorously justifying the mean-field analysis.

📄 Content

다중 처리 코어에서 계산 집약적인 작업을 병렬로 수행하는 것은 오늘날 다양한 실제 응용 분야에서 매우 중요한 요구 사항이다. 예를 들어, 대규모 데이터베이스 검색, 실시간 영상 처리, 과학·공학 시뮬레이션 등은 모두 수많은 연산을 동시에 처리해야 하므로, 여러 코어를 활용한 병렬 처리가 없이는 실시간 성능을 보장하기 어렵다. 이러한 배경에서 본 논문은 작업 병렬성(job parallelism) 에 대한 이상화된 수학적 모델을 제시하고, 그 모델을 통해 병렬성이 시스템 전반의 평균 지연(average delay)에 미치는 영향을 정량적으로 분석한다.

모델 설정

우리는 다음과 같은 가정을 바탕으로 한 이상화된 모델을 고려한다.

- 작업(job) 은 하나의 작업량(size)으로 표현되며, 이 작업량은 평균이 1인 지수 분포(exponential distribution)로부터 독립적으로 샘플링된다. 즉, 각 작업이 요구하는 총 연산량은 확률적으로 변하지만 평균적으로는 1이다.

- 서버(server) 는 총 (n)개의 병렬 프로세서 공유 서버(parallel processor‑sharing servers)로 구성된다. 각 서버는 무한히 작은 단위로 작업을 나누어 처리할 수 있으며, 동시에 여러 작업을 공유한다(Processor‑Sharing, PS) 방식이다.

- 도착 과정(arrival process) 은 전체 시스템에 대해 평균 도착률이 (n\lambda)인 포아송 과정(Poisson process)으로 가정한다. 여기서 (\lambda<1) 은 시스템이 안정(stable)하다는 조건을 의미한다; 즉, 평균적으로 서버 하나당 처리 가능한 작업량보다 도착하는 작업량이 적다.

- 병렬성 파라미터 (d) 가 주어지면, 각 작업은 도착 시 (d)개의 서로 다른 서버를 균등하게 무작위로 선택한다. 선택된 (d)개의 서버에 동시에 합류(join) 하여, 각 서버가 해당 작업에 대해 일정 비율의 처리 능력을 제공한다. 작업은 이 (d)개의 서버가 수행한 작업량의 합이 원래 작업의 전체 크기와 같아지는 순간 완료(completed) 된 것으로 간주한다.

이러한 설정은 실제 클라우드 컴퓨팅 환경에서 하나의 작업을 여러 가상 머신에 분산시키는 상황이나, 멀티코어 프로세서에서 하나의 스레드가 여러 코어에 동시에 스케줄링되는 상황을 추상화한 것이다.

연구 목표

본 연구의 핵심 목표는 병렬성 파라미터 (d) 가 시스템의 평균 점유율(average occupancy) 및 평균 응답 시간(average response time) 에 어떤 정량적 영향을 미치는지를 밝히는 것이다. 특히, (d=1) (즉, 전통적인 단일 서버 서비스)와 (d\ge 2) (다중 서버에 동시에 서비스) 사이의 차이를 비교함으로써, 병렬 처리가 얼마나 큰 성능 향상을 가져올 수 있는지를 이론적으로 증명하고자 한다.

평균장(mean‑field) 분석

우리는 평균장(mean‑field) 방법을 이용하여 대규모 시스템((n\to\infty))에서의 동작을 근사한다. 평균장 분석은 각 서버가 서로 독립적인 동일한 확률 과정을 따를 때, 전체 시스템의 거동을 한 개의 “대표 서버”가 경험하는 평균적인 동역학으로 축소시키는 기법이다. 구체적으로 다음과 같은 절차를 따른다.

- 상태 변수 정의: 각 서버 (i)의 현재 작업량을 (X_i(t))라 두고, 전체 시스템의 점유율을 (\bar X(t)=\frac{1}{n}\sum_{i=1}^{n}X_i(t)) 로 정의한다.

- 한계(large‑(n)) 과정 도출: (n)이 무한히 커질 때, (\bar X(t))는 확률적 변동이 사라지고 결정론적 함수 (x(t))에 수렴한다는 것을 보인다. 이때 (x(t))는 미분 방정식 [ \frac{dx(t)}{dt}= \lambda d , \mathbb{E}\bigl[ \min{1,,\frac{1}{d}x(t)}\bigr] - x(t) ] 와 같은 형태를 만족한다(구체적인 유도 과정은 논문 본문에 상세히 기술됨).

- 정상 상태(stationary) 해석: 시간 (t\to\infty) 일 때 (x(t))가 수렴하는 고정점 (x^*)를 구한다. 이 고정점은 시스템이 안정된 상태에서 각 서버가 평균적으로 차지하는 작업량을 의미한다.

위 과정을 통해 우리는 고정된 (d\ge 2) 이고 (n)이 충분히 클 때, 시스템이 포화 상태((\lambda\to 1^{-}))에 접근함에 따라 평균 점유율이

[ \boxed{ ; \mathbb{E}[ \text{occupancy} ] = O!\bigl(\log \tfrac{1}{1-\lambda}\bigr) ;} ]

와 같은 로그 성장을 보인다는 것을 증명한다. 이는 전통적인 단일 서버 모델((d=1))에서 알려진

[ \mathbb{E}[ \text{occupancy} ] = O!\bigl(\tfrac{1}{1-\lambda}\bigr) ]

와는 근본적으로 다른 스케일이다. 즉, (d\ge 2)인 경우에는 (\lambda)이 1에 매우 가깝게 접근하더라도 평균 점유율이 급격히 증가하지 않으며, 대신 로그 수준으로만 증가한다는 의미이다.

결과의 의미

위의 로그‑성장 결과는 응답 시간(response time) 에 대한 직접적인 함의를 가진다. Processor‑Sharing 서버에서는 평균 점유율이 곧 평균 대기·서비스 시간과 비례하기 때문에, 점유율이 (O(\log \frac{1}{1-\lambda})) 수준으로 억제된다는 것은 작업이 시스템을 떠나는 평균 시간이 지수적으로 감소한다는 것을 의미한다. 구체적으로,

- (d=1) 일 때는 (\lambda)이 0.99와 같이 1에 매우 가깝게 되면 평균 응답 시간이 약 (1/(1-0.99)=100) 배 정도 급증한다.

- (d\ge 2) 일 때는 같은 조건에서도 평균 응답 시간은 (\log(1/(1-0.99))\approx \log(100)\approx 4.6) 배 정도에 머무른다.

따라서 병렬성을 도입함으로써 응답 시간의 감소 효과가 지수적으로(즉, 매우 크게) 향상된다는 결론을 얻는다. 이는 실제 데이터 센터나 클라우드 서비스에서 작업을 여러 서버에 동시에 할당하는 전략이 시스템 전체의 처리량을 크게 높이고, 사용자에게 제공되는 서비스 품질(QoS)을 현저히 개선할 수 있음을 이론적으로 뒷받침한다.

엄밀한 정당화에 대한 진전

평균장 분석은 직관적으로는 설득력 있지만, 수학적으로 엄밀히 증명하기 위해서는 여러 기술적 난관을 극복해야 한다. 특히,

- 독립성 가정(각 서버가 서로 독립적인 마코프 과정으로 동작한다는 가정)을 실제 시스템에 적용할 때 발생하는 상관관계 문제,

- 한계 과정의 수렴(finite‑(n) 시스템이 평균장 방정식으로 수렴한다는 것을 보이는 과정)에서 필요한 강한 대수적 경계(bound)와 확률적 불변량(invariant measures),

- 다중 서버 선택 메커니즘(작업이 무작위로 (d)개의 서버를 선택하는 과정)으로 인한 조합적 복잡성을 다루는 방법,

등이 주요 연구 과제였다. 본 논문에서는 이러한 난관들을 단계별로 해결하기 위한 새로운 확률적 결합(coupling) 기법, 대용량 시스템에서의 마코프 체인 수렴 이론 및 고차원 확률 과정의 집중(concentration) 불평등 등을 도입하였다. 그 결과, 기존에 비공식적으로만 제시되던 평균장 근사식이 정확히(또는 적어도 상한/하한을 포함한 형태로) 정당화될 수 있음을 보였으며, 이는 향후 더 일반적인 병렬 처리 모델에 대한 분석에도 적용 가능한 **기초적인 틀(framework)**을 제공한다.

결론

요약하면, 본 연구는 다음과 같은 중요한 메시지를 전달한다.

- 다중 서버에 동시에 작업을 할당하는 병렬성((d\ge 2))은 시스템이 포화에 가까워질수록 평균 점유율을 로그 수준으로 억제한다. 이는 전통적인 단일 서버 모델에서 나타나는 선형(또는 역비례) 성장과는 근본적으로 다르다.

- 점유율의 로그 억제는 곧 평균 응답 시간의 지수적 감소를 의미하므로, 실제 서비스 환경에서 사용자 지연을 크게 줄일 수 있다.

- 평균장 분석을 엄밀히 정당화하기 위한 새로운 수학적 도구들을 개발함으로써, 기존에 경험적으로만 확인되던 현상을 이론적으로 뒷받침하였다.

- 이러한 결과는 클라우드 컴퓨팅, 분산 데이터베이스, 실시간 스트리밍 등 다양한 분야에서 작업을 어떻게 분산하고 스케줄링할 것인가에 대한 설계 지침을 제공한다.

따라서, 병렬성을 활용한 작업 할당 전략은 단순히 처리량을 늘리는 차원을 넘어, 시스템이 높은 부하에서도 안정적으로 동작하도록 만드는 핵심적인 메커니즘임을 본 논문은 수학적으로 증명한다. 앞으로의 연구에서는 동적 (d) 선택, 서버 간의 비동질성, 네트워크 지연 등을 포함한 보다 복잡한 현실 모델에 평균장 접근법을 확장하는 것이 기대된다.