Learning to Control Complex Robots Using High-Dimensional Interfaces: Preliminary Insights

📝 Abstract

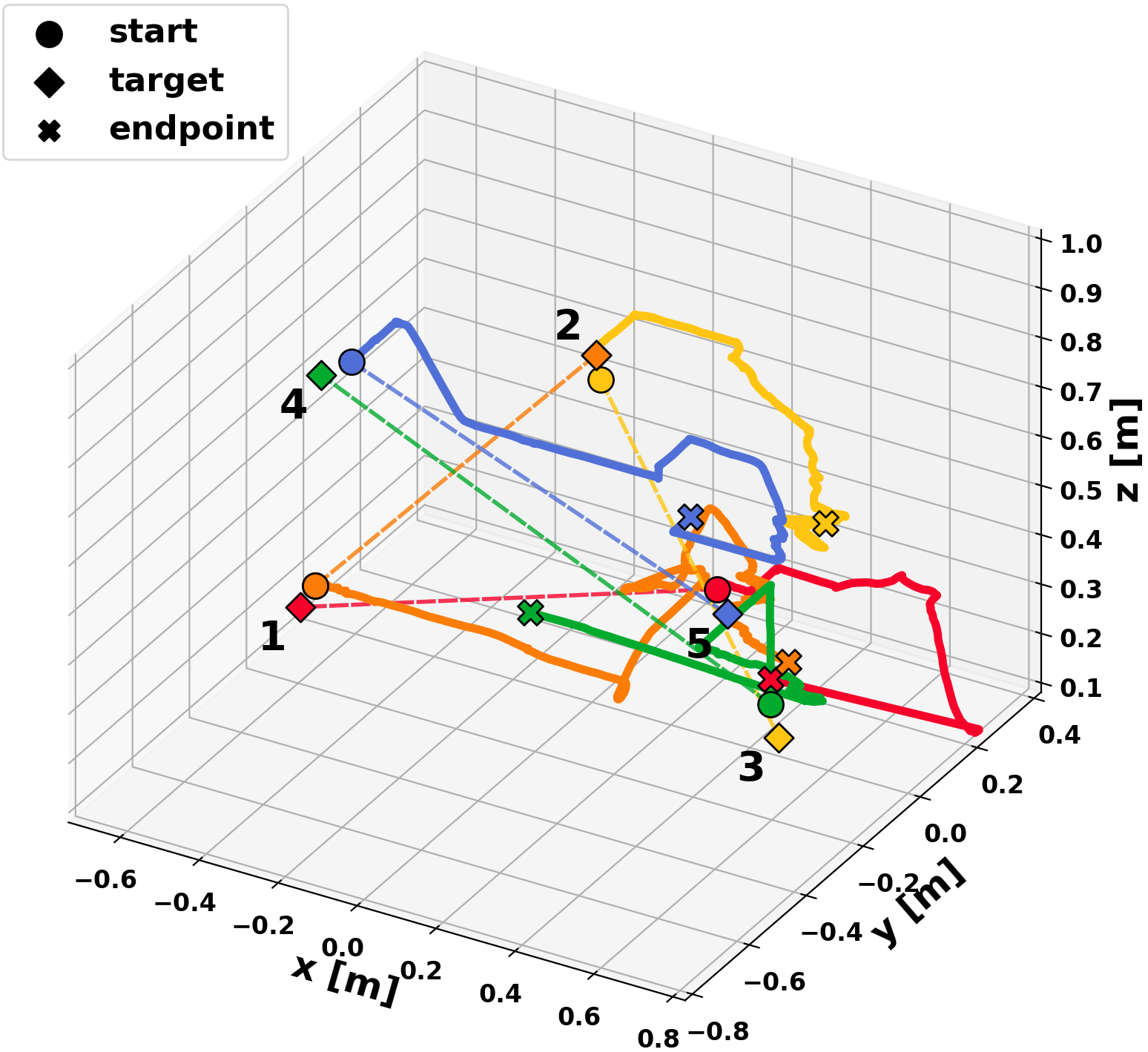

Human body motions can be captured as a high-dimensional continuous signal using motion sensor technologies. The resulting data can be surprisingly rich in information, even when captured from persons with limited mobility. In this work, we explore the use of limited upper-body motions, captured via motion sensors, as inputs to control a 7 degree-of-freedom assistive robotic arm. It is possible that even dense sensor signals lack the salient information and independence necessary for reliable high-dimensional robot control. As the human learns over time in the context of this limitation, intelligence on the robot can be leveraged to better identify key learning challenges, provide useful feedback, and support individuals until the challenges are managed. In this short paper, we examine two uninjured participants’ data from an ongoing study, to extract preliminary results and share insights. We observe opportunities for robot intelligence to step in, including the identification of inconsistencies in time spent across all control dimensions, asymmetries in individual control dimensions, and user progress in learning. Machine reasoning about these situations may facilitate novel interface learning in the future.

💡 Analysis

Human body motions can be captured as a high-dimensional continuous signal using motion sensor technologies. The resulting data can be surprisingly rich in information, even when captured from persons with limited mobility. In this work, we explore the use of limited upper-body motions, captured via motion sensors, as inputs to control a 7 degree-of-freedom assistive robotic arm. It is possible that even dense sensor signals lack the salient information and independence necessary for reliable high-dimensional robot control. As the human learns over time in the context of this limitation, intelligence on the robot can be leveraged to better identify key learning challenges, provide useful feedback, and support individuals until the challenges are managed. In this short paper, we examine two uninjured participants’ data from an ongoing study, to extract preliminary results and share insights. We observe opportunities for robot intelligence to step in, including the identification of inconsistencies in time spent across all control dimensions, asymmetries in individual control dimensions, and user progress in learning. Machine reasoning about these situations may facilitate novel interface learning in the future.

📄 Content

인간의 신체 움직임은 모션 센서 기술을 이용하면 고차원 연속 신호로 캡처될 수 있습니다. 이러한 센서가 생성하는 데이터는 놀라울 정도로 풍부한 정보를 담고 있으며, 특히 움직임이 제한된 사람들로부터 수집된 경우에도 그 가치가 크게 감소하지 않습니다. 본 연구에서는 모션 센서를 통해 얻은 제한된 상체 움직임을 7자유도(DoF) 보조 로봇 팔을 제어하기 위한 입력으로 활용하는 방안을 탐구합니다.

우선, 인간이 제한된 움직임만을 제공할 경우, 센서가 매우 밀집된(high‑density) 신호를 출력하더라도 로봇을 안정적으로 고차원적으로 제어하는 데 필요한 핵심적인 정보와 독립성이 부족할 가능성이 존재합니다. 즉, 센서 데이터 자체가 충분히 정밀하더라도, 그 안에 포함된 특징(feature)이 로봇 제어에 직접적으로 매핑되기에는 한계가 있을 수 있다는 점을 지적하고 있습니다.

이러한 한계 상황에서 인간 사용자는 시간이 흐름에 따라 점진적으로 학습을 진행합니다. 여기서 로봇에 내재된 인공지능은 두 가지 중요한 역할을 수행할 수 있습니다. 첫째, 학습 과정에서 나타나는 핵심적인 학습 과제(key learning challenges) 를 보다 정확히 식별하고, 둘째, 사용자가 겪는 어려움을 완화시키기 위해 유용한 피드백(feedback) 을 제공함으로써 사용자가 목표한 제어 능력을 달성할 때까지 지속적으로 지원할 수 있습니다.

본 논문은 현재 진행 중인 연구에서 두 명의 부상되지 않은 피험자 데이터를 활용하여, 초기 결과를 도출하고 그에 대한 통찰을 공유하고자 합니다. 구체적으로, 우리는 다음과 같은 관찰을 통해 로봇 인텔리전스가 개입할 수 있는 여러 기회를 확인했습니다.

- 제어 차원 전반에 걸친 시간 사용의 불일치(inconsistencies in time spent across all control dimensions) – 사용자가 각 자유도를 조작하는 데 소요하는 시간이 균등하지 않으며, 이는 사용자의 의도와 실제 제어 사이에 존재하는 차이를 드러냅니다.

- 개별 제어 차원의 비대칭성(asymmetries in individual control dimensions) – 특정 축이나 관절에 대한 조작이 다른 축에 비해 과도하게 강조되거나, 반대로 충분히 활용되지 않는 현상이 포착됩니다.

- 학습 진행 상황(user progress in learning) – 시간에 따라 사용자가 제어 정확도와 반응 속도에서 점진적인 향상을 보이는지 여부를 정량적으로 추적할 수 있습니다.

이러한 상황에 대한 기계적 추론(machine reasoning) 은 향후 새로운 인터페이스 학습 방식을 촉진할 수 있는 기반이 될 것으로 기대됩니다. 예를 들어, 로봇이 실시간으로 사용자의 비대칭성을 감지하고, 해당 차원을 보조하거나 자동 보정함으로써 사용자가 보다 균형 잡힌 움직임을 연습하도록 유도할 수 있습니다. 또한, 시간 사용의 불일치를 분석하여 특정 차원의 학습 난이도가 높다는 신호를 포착하고, 그에 맞는 맞춤형 훈련 시나리오를 제공함으로써 전체 학습 효율을 극대화할 수 있습니다.

요약하면, 제한된 상체 움직임만으로도 7 DoF 보조 로봇 팔을 제어하는 것이 가능하다는 점을 실증적으로 보여주면서, 동시에 로봇 인공지능이 인간 학습 과정에 개입하여 정보 부족을 보완하고, 피드백을 제공하며, 사용자의 진행 상황을 지속적으로 모니터링하고 지원할 수 있음을 확인했습니다. 앞으로의 연구에서는 보다 다양한 피험자군과 장시간에 걸친 데이터 수집을 통해 현재 관찰된 현상의 일반성을 검증하고, 인공지능 기반 피드백 메커니즘을 정교화함으로써 실제 보조 로봇 시스템에 적용 가능한 지능형 인터페이스 를 구현하는 것이 목표입니다.

이와 같은 접근은 특히 움직임이 제한된 장애인이나 재활 단계에 있는 환자들에게 보다 직관적이고 효율적인 로봇 보조 를 제공함으로써, 일상 생활에서의 자율성을 크게 향상시킬 수 있는 잠재력을 가지고 있습니다. 따라서 본 연구는 인간‑로봇 상호작용(HRI) 분야에서 센서 데이터와 인공지능을 결합한 새로운 제어 패러다임 을 제시하는 중요한 초석이 될 것입니다.