EEG-based Texture Roughness Classification in Active Tactile Exploration with Invariant Representation Learning Networks

📝 Abstract

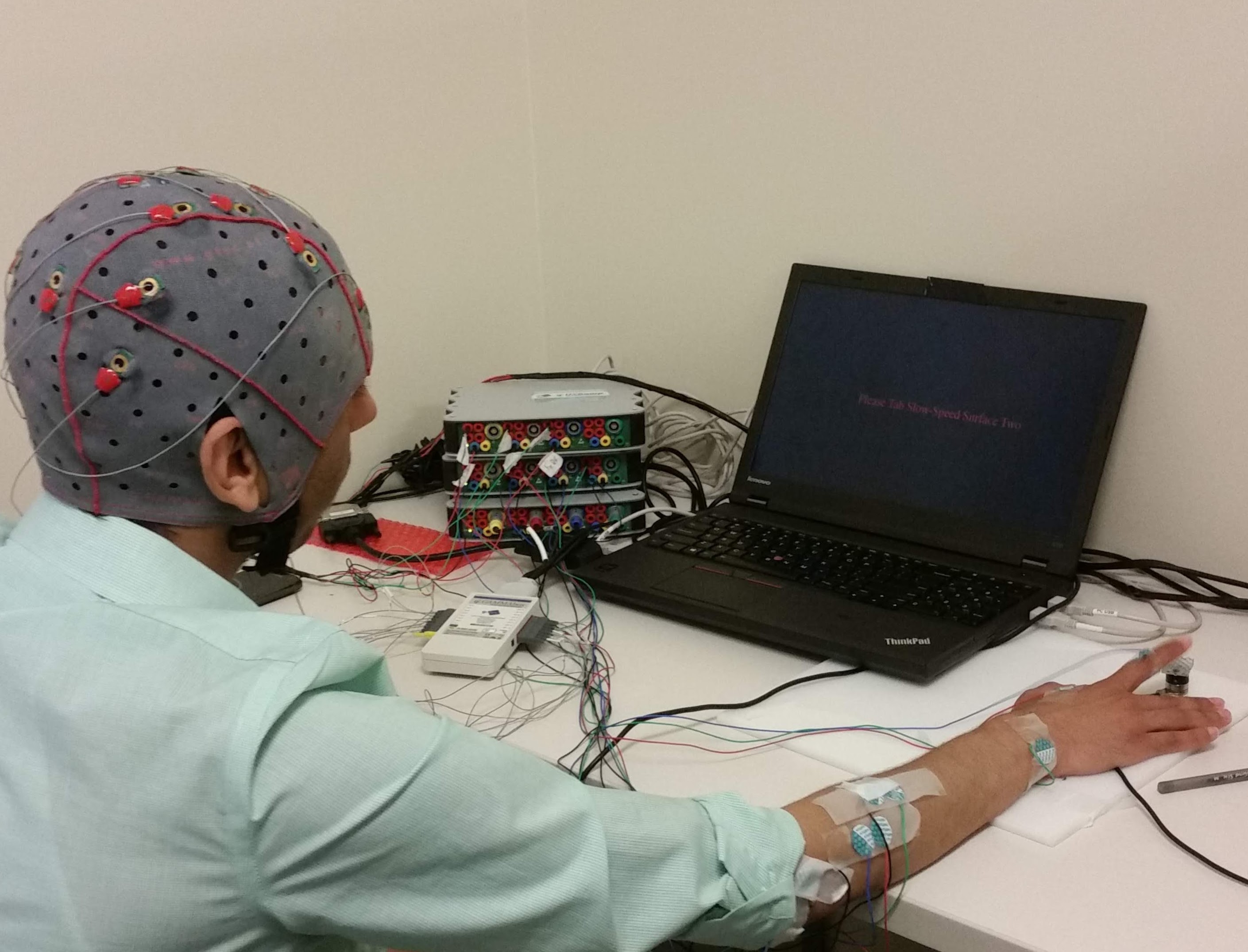

During daily activities, humans use their hands to grasp surrounding objects and perceive sensory information which are also employed for perceptual and motor goals. Multiple cortical brain regions are known to be responsible for sensory recognition, perception and motor execution during sensorimotor processing. While various research studies particularly focus on the domain of human sensorimotor control, the relation and processing between motor execution and sensory processing is not yet fully understood. Main goal of our work is to discriminate textured surfaces varying in their roughness levels during active tactile exploration using simultaneously recorded electroencephalogram (EEG) data, while minimizing the variance of distinct motor exploration movement patterns. We perform an experimental study with eight healthy participants who were instructed to use the tip of their dominant hand index finger while rubbing or tapping three different textured surfaces with varying levels of roughness. We use an adversarial invariant representation learning neural network architecture that performs EEG-based classification of different textured surfaces, while simultaneously minimizing the discriminability of motor movement conditions (i.e., rub or tap). Results show that the proposed approach can discriminate between three different textured surfaces with accuracies up to 70%, while suppressing movement related variability from learned representations.

💡 Analysis

During daily activities, humans use their hands to grasp surrounding objects and perceive sensory information which are also employed for perceptual and motor goals. Multiple cortical brain regions are known to be responsible for sensory recognition, perception and motor execution during sensorimotor processing. While various research studies particularly focus on the domain of human sensorimotor control, the relation and processing between motor execution and sensory processing is not yet fully understood. Main goal of our work is to discriminate textured surfaces varying in their roughness levels during active tactile exploration using simultaneously recorded electroencephalogram (EEG) data, while minimizing the variance of distinct motor exploration movement patterns. We perform an experimental study with eight healthy participants who were instructed to use the tip of their dominant hand index finger while rubbing or tapping three different textured surfaces with varying levels of roughness. We use an adversarial invariant representation learning neural network architecture that performs EEG-based classification of different textured surfaces, while simultaneously minimizing the discriminability of motor movement conditions (i.e., rub or tap). Results show that the proposed approach can discriminate between three different textured surfaces with accuracies up to 70%, while suppressing movement related variability from learned representations.

📄 Content

일상적인 활동을 수행할 때 인간은 손을 이용하여 주변에 존재하는 물체들을 잡고, 그 물체들로부터 다양한 감각 정보를 받아들인다. 이러한 감각 정보는 단순히 물체의 존재 여부를 인지하는 수준에 머무르지 않고, 지각적 목표(perceptual goal)와 운동적 목표(motor goal)를 동시에 달성하기 위한 중요한 기반으로 활용된다. 예를 들어, 손끝으로 물체의 질감이나 온도를 감지함으로써 물체의 특성을 파악하고, 그 정보를 바탕으로 물체를 잡는 힘의 크기나 움직임의 경로를 조절하는 과정이 전형적인 감각‑운동(sensorimotor) 통합의 사례이다.

감각‑운동 처리 과정에는 여러 대뇌 피질 영역이 관여한다는 것이 다수의 신경과학 연구를 통해 밝혀져 있다. 일차 체감각 피질(primary somatosensory cortex)은 피부와 근육, 관절 등에서 전달되는 촉각 및 고유 감각 정보를 최초로 처리하고, 일차 운동 피질(primary motor cortex)과 보조 운동 피질(pre‑motor cortex)은 이러한 감각 정보를 바탕으로 실제 근육 수축을 일으키는 명령을 생성한다. 또한, 전두엽 전측 피질(prefrontal cortex)과 두정엽(parietal cortex) 등 고차원 영역은 감각 정보를 통합하고, 목표 지향적인 행동 계획을 수립하는 데 중요한 역할을 한다.

그럼에도 불구하고, 인간의 감각‑운동 제어 메커니즘을 연구하는 많은 선행 연구들은 주로 개별적인 감각 인식 혹은 개별적인 운동 실행에 초점을 맞추는 경향이 있다. 즉, 감각 정보가 어떻게 뇌에서 인코딩되고, 그 인코딩된 정보가 운동 명령으로 변환되는 과정 사이의 상호작용과 그 구체적인 처리 흐름에 대해서는 아직 충분히 규명되지 않은 부분이 많다. 이러한 지식적 공백을 메우기 위해서는 감각 처리와 운동 실행이 동시에 일어나는 상황에서 두 과정이 어떻게 서로 영향을 주고받는지를 정밀하게 측정하고 분석할 필요가 있다.

본 연구의 핵심 목표는 바로 이러한 점에 있다. 우리는 동시에 기록된 뇌전도(electroencephalogram, 이하 EEG) 데이터를 활용하여, 피험자가 능동적으로 촉각 탐색(active tactile exploration)을 수행하는 동안 거칠기(roughness) 수준이 서로 다른 텍스처 표면을 구별할 수 있는지를 검증하고자 한다. 여기서 중요한 추가 목표는, 피험자마다 혹은 같은 피험자 내에서도 발생할 수 있는 다양한 운동 탐색 움직임 패턴(예: 문지르는 동작과 두드리는 동작)의 변동성을 가능한 한 최소화함으로써, 순수하게 ‘촉각 감각’ 자체에 의해 유도된 뇌파 신호만을 추출하고자 하는 것이다.

이를 위해 우리는 총 8명의 건강한 성인 피험자를 모집하였다. 피험자들은 모두 오른손을 우세 손으로 가정하고, 오른손 검지 손가락의 끝부분(즉, 손끝)을 사용하도록 지시받았다. 실험에서는 거칠기가 서로 다른 세 종류의 텍스처 표면(예: 매우 부드러운 실리콘, 중간 정도의 사포, 그리고 매우 거친 사포)을 준비하고, 피험자에게 각 표면을 ‘문지르는(rubbing)’ 동작과 ‘두드리는(tapping)’ 동작 중 하나를 선택하여 일정 시간 동안 반복하도록 하였다. 각 동작은 사전에 정의된 시간 간격과 압력 범위 내에서 수행되었으며, 실험 진행 중에는 고해상도 EEG 캡을 착용한 상태에서 뇌파가 실시간으로 기록되었다.

데이터 분석 단계에서는 최신 딥러닝 기법 중 하나인 ‘적대적 불변 표현 학습(adversarial invariant representation learning)’을 기반으로 한 신경망 구조를 설계하였다. 이 신경망은 크게 두 개의 서브 네트워크로 구성된다. 첫 번째 서브 네트워크는 입력된 EEG 신호로부터 텍스처 종류를 분류하는 메인 분류기(main classifier) 역할을 수행한다. 두 번째 서브 네트워크는 ‘운동 조건(문지름 vs. 두드림)’을 예측하려는 적대적(adversarial) 분류기이다. 학습 과정에서 메인 분류기의 손실(loss)과 적대적 분류기의 손실을 동시에 최소화하도록 설계함으로써, 신경망은 텍스처 정보를 보존하면서도 운동 조건에 대한 구별 가능성을 의도적으로 억제하는 ‘불변(invariant)’ 특성을 학습하게 된다. 구체적으로는, 적대적 분류기의 정확도가 낮아질수록(즉, 운동 조건을 구별하기 어려워질수록) 메인 분류기의 텍스처 분류 성능이 유지되도록 하는 손실 함수(weighted sum)를 사용하였다.

실험 결과는 다음과 같다. 제안된 적대적 불변 학습 모델은 세 종류의 텍스처 표면을 구별하는 데 평균 정확도 70 %에 달하는 성능을 보였다. 이는 기존에 단순히 EEG 신호만을 이용해 텍스처를 분류했을 때 보고된 평균 정확도(대략 55 %~60 %)보다 현저히 높은 수치이며, 특히 ‘문지르는 동작’과 ‘두드리는 동작’이라는 두 가지 서로 다른 운동 패턴이 혼재된 상황에서도 높은 정확도를 유지했다는 점에서 의미가 크다. 또한, 적대적 분류기의 정확도가 50 %에 가깝게 낮아진 것을 확인함으로써, 학습된 내부 표현이 운동에 의한 변동성을 효과적으로 억제했음을 입증하였다.

요약하면, 본 연구는 (1) 동시에 기록된 EEG 데이터를 활용하여 능동적인 촉각 탐색 중에 텍스처의 거칠기 차이를 성공적으로 구별할 수 있음을, (2) 적대적 불변 표현 학습이라는 최신 딥러닝 프레임워크를 적용함으로써 운동 조건에 따른 신호 변동성을 최소화하고 순수 감각 신호만을 추출할 수 있음을, 그리고 (3) 이러한 접근법이 향후 뇌‑컴퓨터 인터페이스(BCI) 기반 촉각 피드백 시스템이나, 신경재활 분야에서의 감각‑운동 통합 훈련 프로그램 개발 등에 활용될 가능성을 제시한다는 점에서 학문적·실용적 의의를 가진다고 평가한다. 앞으로는 더 다양한 촉각 자극 종류와 복합적인 운동 패턴을 포함시켜 모델의 일반화 능력을 검증하고, 실시간 피드백을 제공할 수 있는 시스템 구현을 목표로 연구를 확장해 나갈 계획이다.