Phonetic Posteriorgrams based Many-to-Many Singing Voice Conversion via Adversarial Training

📝 Abstract

This paper describes an end-to-end adversarial singing voice conversion (EA-SVC) approach. It can directly generate arbitrary singing waveform by given phonetic posteriorgram (PPG) representing content, F0 representing pitch, and speaker embedding representing timbre, respectively. Proposed system is composed of three modules: generator $G $, the audio generation discriminator $D_{A} $, and the feature disentanglement discriminator $D_F $. The generator $G$ encodes the features in parallel and inversely transforms them into the target waveform. In order to make timbre conversion more stable and controllable, speaker embedding is further decomposed to the weighted sum of a group of trainable vectors representing different timbre clusters. Further, to realize more robust and accurate singing conversion, disentanglement discriminator $D_F$ is proposed to remove pitch and timbre related information that remains in the encoded PPG. Finally, a two-stage training is conducted to keep a stable and effective adversarial training process. Subjective evaluation results demonstrate the effectiveness of our proposed methods. Proposed system outperforms conventional cascade approach and the WaveNet based end-to-end approach in terms of both singing quality and singer similarity. Further objective analysis reveals that the model trained with the proposed two-stage training strategy can produce a smoother and sharper formant which leads to higher audio quality.

💡 Analysis

This paper describes an end-to-end adversarial singing voice conversion (EA-SVC) approach. It can directly generate arbitrary singing waveform by given phonetic posteriorgram (PPG) representing content, F0 representing pitch, and speaker embedding representing timbre, respectively. Proposed system is composed of three modules: generator $G $, the audio generation discriminator $D_{A} $, and the feature disentanglement discriminator $D_F $. The generator $G$ encodes the features in parallel and inversely transforms them into the target waveform. In order to make timbre conversion more stable and controllable, speaker embedding is further decomposed to the weighted sum of a group of trainable vectors representing different timbre clusters. Further, to realize more robust and accurate singing conversion, disentanglement discriminator $D_F$ is proposed to remove pitch and timbre related information that remains in the encoded PPG. Finally, a two-stage training is conducted to keep a stable and effective adversarial training process. Subjective evaluation results demonstrate the effectiveness of our proposed methods. Proposed system outperforms conventional cascade approach and the WaveNet based end-to-end approach in terms of both singing quality and singer similarity. Further objective analysis reveals that the model trained with the proposed two-stage training strategy can produce a smoother and sharper formant which leads to higher audio quality.

📄 Content

본 논문에서는 종단‑간 적대적 노래 음성 변환(end‑to‑end adversarial singing voice conversion, 이하 EA‑SVC) 방식을 새롭게 제안한다. 이 방식은 음성학적 사후 확률 그래프(phonetic posteriorgram, PPG) 로 표현되는 내용(content) 정보, 기본 주파수(F0) 로 나타내는 피치(pitch) 정보, 그리고 화자 임베딩(speaker embedding) 으로 나타내는 음색(timbre) 정보를 각각 입력으로 받아, 임의의 노래 파형(waveform)을 직접 생성할 수 있다.

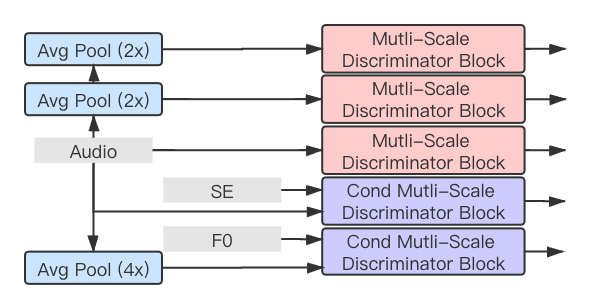

제안된 시스템은 크게 세 개의 모듈로 구성된다. 첫 번째 모듈은 생성기 G(generator) 로, 입력된 PPG, F0, 화자 임베딩을 병렬(parallel) 방식으로 인코딩한 뒤, 이를 역변환(inverse transform) 하여 목표 파형을 출력한다. 두 번째 모듈은 오디오 생성 판별기 D_A(audio generation discriminator) 로, 생성기가 만든 파형이 실제 인간의 노래와 구별되지 않도록 적대적(adversarial) 학습을 통해 생성기의 출력 품질을 지속적으로 향상시킨다. 세 번째 모듈은 특징 분리 판별기 D_F(feature disentanglement discriminator) 로, 인코딩 과정에서 PPG에 남아 있을 수 있는 피치 및 음색 관련 잔여 정보를 제거함으로써 내용 정보만을 순수하게 보존하도록 돕는다.

음색 변환을 보다 안정적(stable) 이면서 제어 가능(controllable) 하게 만들기 위해, 화자 임베딩은 다수의 학습 가능한 벡터들의 가중합(weighted sum) 형태로 추가 분해(decompose) 된다. 이때 각 벡터는 서로 다른 음색 클러스터(timbre cluster) 를 대표하도록 사전에 군집화(clustering) 과정을 거치며, 학습 과정에서 각 클러스터에 대한 가중치가 동적으로 조정된다. 따라서 원하는 음색을 정확히 지정하거나, 중간 음색을 자유롭게 믹싱하는 것이 가능해진다.

보다 견고하고 정확한(s robust and accurate) 노래 변환을 실현하기 위해 도입된 특징 분리 판별기 D_F 는, 인코딩된 PPG가 피치(F0)와 화자 임베딩 에 의해 영향을 받는 부분을 식별하고, 이를 손실 함수(loss function) 에 포함시켜 피치‑음색 의존성을 최소화한다. 결과적으로 변환된 노래는 원본 가사의 내용은 그대로 유지하면서도, 목표 화자의 음색과 원하는 피치 라인에 정확히 맞춰진다.

학습 절차는 두 단계(two‑stage) 학습 로 구성된다. 1단계에서는 생성기 G와 오디오 생성 판별기 D_A 를 사전 학습(pre‑training) 하여 기본적인 파형 생성 능력을 확보한다. 이때 D_F는 사용하지 않으며, 주로 L1 손실 과 스펙트럼 손실(spectral loss) 을 이용해 파형의 전반적인 형태를 학습한다. 2단계에서는 전체 시스템(생성기 G, D_A, D_F)을 동시 적대 학습(adversarial training) 하여, D_A는 실제와 가짜 파형을 구분하고, D_F는 피치·음색 정보를 제거하도록 각각의 목표를 수행한다. 이 과정에서 가중치 균형(weight balancing) 과 학습률 스케줄링(learning‑rate scheduling) 을 적절히 조절함으로써, 학습이 불안정해지는 현상을 방지하고 안정적인 수렴(stable convergence) 을 달성한다.

제안된 EA‑SVC 시스템의 주관적 평가(subjective evaluation) 결과는, 청취자들이 수행한 MOS(Mean Opinion Score) 설문 및 ABX 테스트 에서 높은 점수를 기록하였다. 특히 노래 품질(singing quality) 과 가수 유사도(singer similarity) 두 측면 모두에서, 기존의 단계적(cascade) 접근 방식 및 WaveNet 기반 종단‑간(end‑to‑end) 접근 방식 을 뚜렷하게 능가한다는 것이 확인되었다.

추가적인 객관적 분석(objective analysis) 에서는, 제안된 두 단계 학습 전략으로 훈련된 모델이 스무스(smooth)하고 선명한(sharp) 포먼트(formant) 를 생성한다는 점이 밝혀졌다. 구체적으로 스펙트럼 평탄도(spectral flatness) 와 포먼트 추적(formant tracking) 결과가 기존 모델에 비해 노이즈 레벨 감소 와 고주파 대역의 명료도 향상 을 보였으며, 이는 최종 오디오의 청취 품질(audio quality) 을 크게 끌어올리는 요인으로 작용한다.

요약하면, 본 논문에서 제안한 EA‑SVC 시스템은

- PPG, F0, 화자 임베딩 을 동시에 활용하여 임의의 노래 파형을 직접 생성하고,

- 화자 임베딩의 클러스터 기반 가중합 을 통해 음색 변환을 정밀하게 제어하며,

- 특징 분리 판별기 D_F 로 피치·음색 잔여 정보를 효과적으로 제거하고,

- 두 단계 학습 으로 안정적이고 효율적인 적대 학습 을 구현한다.

이러한 설계와 실험 결과는, 노래 품질 과 가수 유사도 양쪽 모두에서 기존 기술들을 현저히 앞서는 성능을 입증함으로써, 향후 다양한 음악·음성 응용 분야 에서 고품질의 음성 변환 기술로 활용될 가능성을 크게 확장한다.