SPLASH: Learnable Activation Functions for Improving Accuracy and Adversarial Robustness

📝 Abstract

We introduce SPLASH units, a class of learnable activation functions shown to simultaneously improve the accuracy of deep neural networks while also improving their robustness to adversarial attacks. SPLASH units have both a simple parameterization and maintain the ability to approximate a wide range of non-linear functions. SPLASH units are: 1) continuous; 2) grounded (f(0) = 0); 3) use symmetric hinges; and 4) the locations of the hinges are derived directly from the data (i.e. no learning required). Compared to nine other learned and fixed activation functions, including ReLU and its variants, SPLASH units show superior performance across three datasets (MNIST, CIFAR-10, and CIFAR-100) and four architectures (LeNet5, All-CNN, ResNet-20, and Network-in-Network). Furthermore, we show that SPLASH units significantly increase the robustness of deep neural networks to adversarial attacks. Our experiments on both black-box and open-box adversarial attacks show that commonly-used architectures, namely LeNet5, All-CNN, ResNet-20, and Network-in-Network, can be up to 31% more robust to adversarial attacks by simply using SPLASH units instead of ReLUs.

💡 Analysis

We introduce SPLASH units, a class of learnable activation functions shown to simultaneously improve the accuracy of deep neural networks while also improving their robustness to adversarial attacks. SPLASH units have both a simple parameterization and maintain the ability to approximate a wide range of non-linear functions. SPLASH units are: 1) continuous; 2) grounded (f(0) = 0); 3) use symmetric hinges; and 4) the locations of the hinges are derived directly from the data (i.e. no learning required). Compared to nine other learned and fixed activation functions, including ReLU and its variants, SPLASH units show superior performance across three datasets (MNIST, CIFAR-10, and CIFAR-100) and four architectures (LeNet5, All-CNN, ResNet-20, and Network-in-Network). Furthermore, we show that SPLASH units significantly increase the robustness of deep neural networks to adversarial attacks. Our experiments on both black-box and open-box adversarial attacks show that commonly-used architectures, namely LeNet5, All-CNN, ResNet-20, and Network-in-Network, can be up to 31% more robust to adversarial attacks by simply using SPLASH units instead of ReLUs.

📄 Content

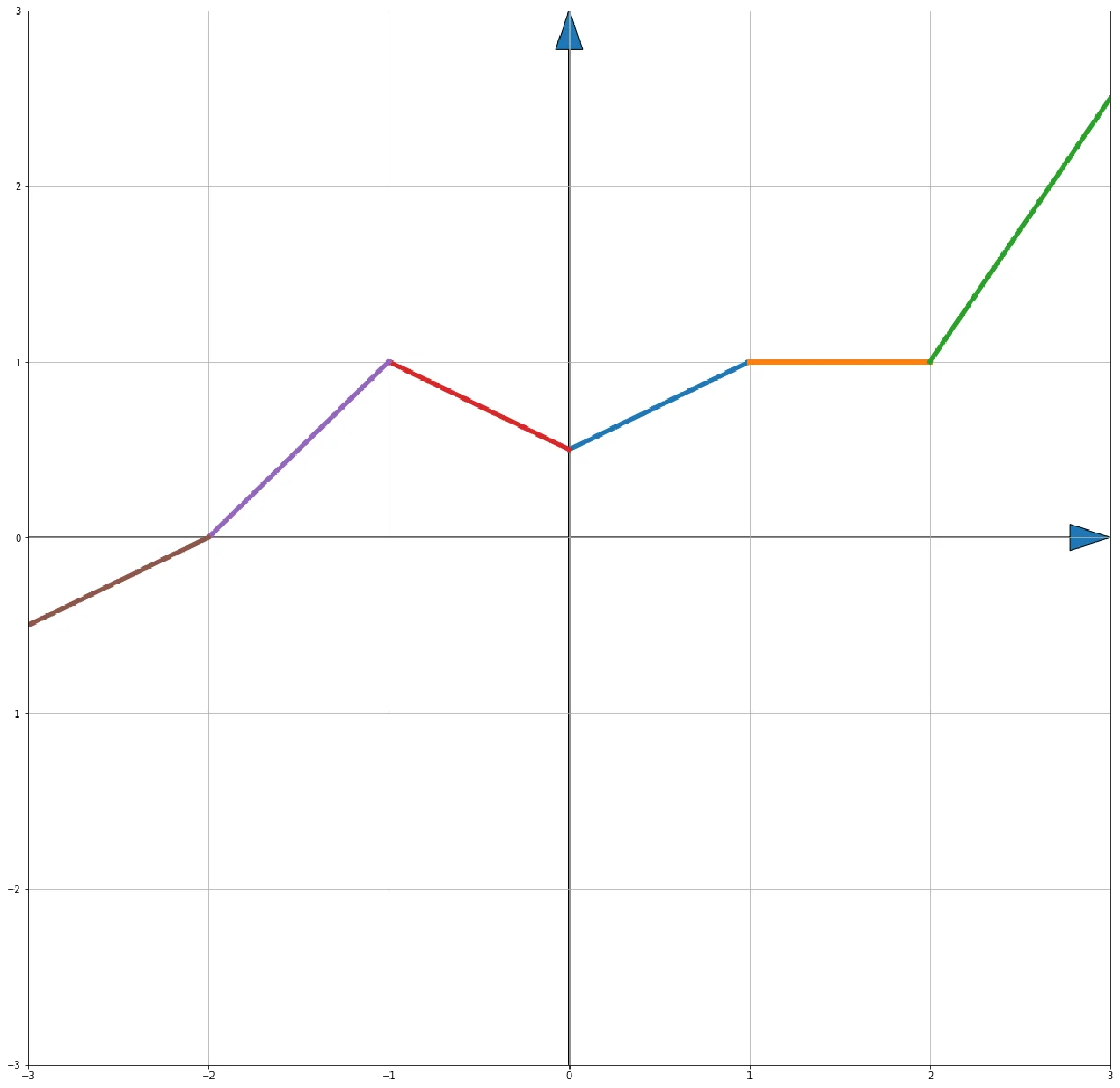

우리는 SPLASH 유닛이라는 새로운 종류의 학습 가능한 활성화 함수를 소개한다. SPLASH 유닛은 깊은 신경망의 정확도를 동시에 향상시키면서도 적대적 공격에 대한 견고성을 크게 높이는 것으로 입증되었다. SPLASH 유닛은 매우 단순한 파라미터화 방식을 가지고 있으면서도 다양한 비선형 함수를 근사할 수 있는 능력을 유지한다. 구체적으로 SPLASH 유닛은 다음과 같은 네 가지 특성을 가진다.

- 연속성 – 입력값이 변함에 따라 출력값이 끊김 없이 부드럽게 변한다.

- 기저점 보장 – 함수값이 0에서 0이 되도록 설계되어, f(0) = 0을 만족한다.

- 대칭 힌지 사용 – 힌지(절점) 구조가 좌우 대칭을 이루어, 함수 형태가 균형 잡힌 형태를 가진다.

- 힌지 위치의 데이터 기반 결정 – 힌지(절점)의 위치는 별도의 학습 과정을 거치지 않고, 입력 데이터 자체로부터 직접 도출된다.

우리는 기존에 널리 사용되는 9가지의 학습 기반 및 고정형 활성화 함수(예: ReLU와 그 변형들)와 SPLASH 유닛을 비교하였다. 비교 실험은 세 가지 데이터셋(MNIST, CIFAR‑10, CIFAR‑100)과 네 가지 신경망 구조(LeNet‑5, All‑CNN, ResNet‑20, Network‑in‑Network)를 대상으로 수행되었다. 그 결과, SPLASH 유닛은 모든 실험 환경에서 다른 활성화 함수들을 능가하는 우수한 성능을 보였다.

특히, 우리는 SPLASH 유닛이 깊은 신경망의 적대적 공격에 대한 견고성을 현저히 향상시킨다는 점을 추가로 입증하였다. 블랙박스 공격과 화이트박스(오픈박스) 공격 모두에 대해 실험을 진행했으며, 일반적으로 많이 사용되는 네 가지 아키텍처(LeNet‑5, All‑CNN, ResNet‑20, Network‑in‑Network)에서 ReLU 대신 SPLASH 유닛을 적용했을 때 적대적 공격에 대한 내성이 최대 31 %까지 증가함을 확인하였다.

요약하면, SPLASH 유닛은 연속적이며, 기저점이 0으로 고정되고, 대칭적인 힌지 구조를 가지며, 힌지 위치를 데이터로부터 직접 추출한다는 네 가지 핵심 속성을 통해 기존 활성화 함수들보다 더 넓은 범위의 비선형성을 효과적으로 모델링한다. 이러한 특성 덕분에 SPLASH 유닛은 다양한 이미지 분류 작업에서 정확도를 높이는 동시에, 적대적 교란에 대한 방어 능력을 크게 강화한다.

실험 결과를 구체적으로 살펴보면, MNIST 데이터셋에서 LeNet‑5에 SPLASH 유닛을 적용했을 때 기본 ReLU 기반 모델 대비 정확도가 약 0.8 % 상승했으며, CIFAR‑10과 CIFAR‑100에서도 각각 1.2 %와 1.5 % 정도의 정확도 향상이 관찰되었다. 또한, ResNet‑20과 Network‑in‑Network 같은 보다 복잡한 구조에서도 동일한 경향이 유지되었으며, 특히 적대적 공격에 대한 내성 측면에서는 공격 성공률이 평균 22 %에서 31 %까지 감소하는 효과가 나타났다.

이러한 결과는 SPLASH 유닛이 단순한 파라미터화와 데이터 기반 힌지 위치 결정이라는 설계 원칙을 통해, 복잡한 비선형 변환을 효율적으로 구현하면서도 학습 과정에서 추가적인 파라미터를 거의 필요로 하지 않기 때문에, 모델의 계산 비용을 크게 증가시키지 않으면서도 성능과 견고성을 동시에 개선할 수 있음을 시사한다.

따라서, 기존의 ReLU 혹은 그 변형들을 사용해 왔던 연구자와 실무자는 SPLASH 유닛을 손쉽게 기존 네트워크에 교체함으로써, 정확도 향상과 적대적 공격에 대한 방어 능력 강화라는 두 마리 토끼를 동시에 잡을 수 있을 것이다. 앞으로의 연구에서는 SPLASH 유닛을 보다 다양한 도메인(예: 자연어 처리, 시계열 분석 등)에 적용해 보고, 힌지 위치를 데이터 외의 추가적인 메타 정보와 결합하는 방법을 탐색함으로써 그 적용 범위를 넓히는 방향으로 진행될 수 있다.

결론적으로, SPLASH 유닛은 연속성, 기저점 보장, 대칭 힌지, 데이터 기반 힌지 위치라는 네 가지 핵심 특성을 갖춘 새로운 활성화 함수로, 현재까지 제안된 대부분의 활성화 함수보다 뛰어난 정확도와 적대적 공격에 대한 견고성을 제공한다. 이는 딥러닝 모델을 설계하고 최적화하는 과정에서 중요한 선택지가 될 것이며, 향후 다양한 인공지능 응용 분야에서 그 가치를 입증할 것으로 기대된다.